在2024年的中国数据科技领域,一项重要的成果于CCF中国数据大会上正式亮相。这份名为《生成式大模型安全测评白皮书(2024)》的报告,由中国科学院智能算法安全重点实验室携手公安部第三研究所及蚂蚁集团的蚂蚁安全实验室共同编制,标志着我国在生成式大模型安全领域的深入研究与积极应对。

白皮书深入剖析了包括GPT、LLaMA、Moss、文心一言等在内的近20个主流生成式大模型的发展现状,并着重揭示了这些模型在实际应用中面临的安全风险。通过一系列实践案例,白皮书不仅指出了当前技术面临的关键挑战,还提供了有效的应对策略。报告将安全风险分为伦理风险、技术安全风险及内容安全风险三大类,并创造性地提出了指标衡量与模型攻击两种安全评估方法,以及伦理性、隐私性、事实性、鲁棒性四大安全评估维度,为相关领域的研究者、产业实践者及政策制定者提供了宝贵的参考。

蚂蚁集团自主研发的“支小宝”三重安全保障框架在白皮书中得到了特别介绍,这一框架背后是蚂蚁集团的大模型安全一体化解决方案“蚁天鉴”。该解决方案包含两大核心产品:“蚁鉴”大模型安全检测平台和“天鉴”大模型风险防御平台,分别专注于AI评测与安全防御,确保大模型在生产和应用中的安全、可控与可靠。

自ChatGPT引领的生成式大模型热潮以来,全球范围内对这类技术的关注日益升温。作为人工智能技术的新一轮革命性成果,生成式大模型正深刻改变着全球AI技术的格局,并为我国数字经济的高质量发展和智能化转型注入了强劲动力。然而,随着技术应用的日益广泛,其潜在的安全风险也逐渐暴露出来,如“大模型幻觉”事件和三星公司机密资料泄露等,这些事件凸显了生成式大模型在隐私保护、恶意滥用、技术漏洞及合规性等方面的复杂挑战。

针对这些风险,国家高度重视,并出台了一系列政策文件,如《生成式人工智能服务管理暂行办法》,明确了生成式大模型在安全性、风险防控和合规性方面的基本原则和监管要求,为技术的健康发展提供了有力的政策保障。

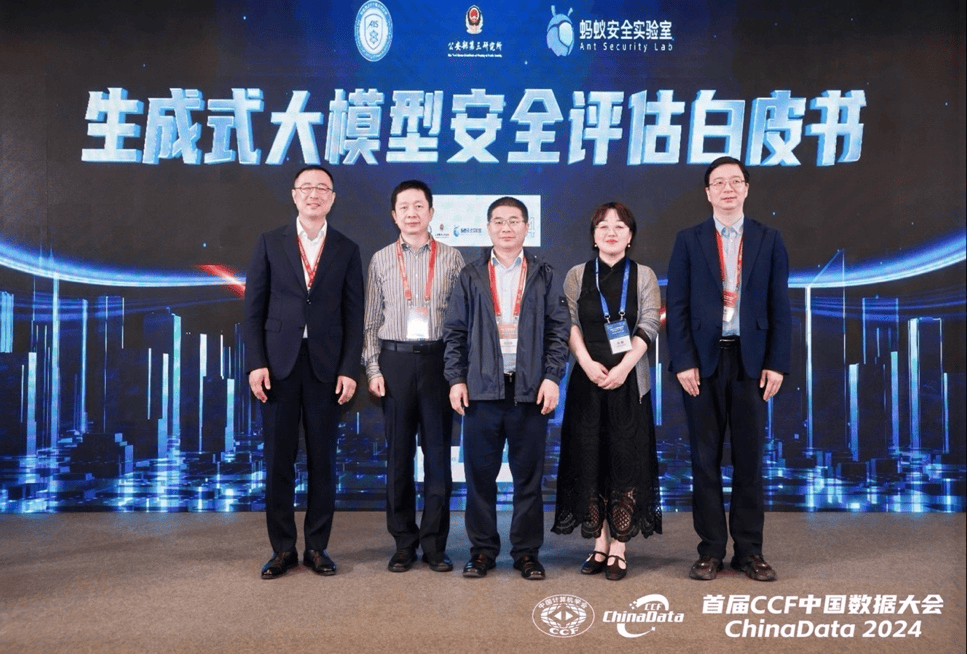

在白皮书的发布仪式上,来自中国科学院智能算法安全重点实验室、公安部第三研究所、蚂蚁安全实验室及浙江大学计算机学院的专家学者齐聚一堂,共同见证了这一重要时刻。智能算法安全重点实验室主任、中国科学院计算技术研究所副所长程学旗,公安部第三研究所副所长张巍,蚂蚁安全实验室首席科学家、蚂蚁集团大安全机器智能部总经理王维强,以及中国数据大会数据安全高端论坛召集人、浙江大学计算机学院院长任奎,中国科学院计算技术研究所网络数据科学与技术重点实验室主任郭嘉丰等重量级嘉宾出席了发布仪式。

王维强在仪式上表示:“我们希望通过这份白皮书,能够助力生成式大模型的安全性研究与应用推广,为构建安全、可靠、可控的人工智能生态体系提供坚实支撑,推动技术向着服务人类社会的方向健康发展。”